Lernen von KI-Anwendungen

Generative KI schleicht sich zunehmend in fast jede Aufgabe ein, an der ich heutzutage arbeite, also ist es an der Zeit, …

.

Für mich hat die Corona-Zeit arbeitsmäßig nicht viel Neues gebracht - auch vorher habe ich schon viel von Zuhause gearbeitet, gelegentlich in Videokonferenzen, meist per Telefonkonferenz und Screensharing.

Der Boom von Zoom und vergleichbaren andere Systemen wie Teams, Jitsi, BigBlueButton hat inzwischen jedoch die Kommunikation geändert. Nur selten wird noch telefoniert, meist wird gleich per Video Call gechattet. Daher habe ich mich kürzlich entschlossen, meinen Arbeitsplatz endlich so auszustatten, dass ich diese Arbeitsweise optimal unterstützen kann. Ich wollte

Klingt aufwändig! Am längsten hat die Suche nach Konzepten und den passenden Tools gedauert. Als ich diese zusammen hatte, ging das Setup erfreulich schnell voran. Noch nicht perfekt, aber ein guter Start, mit dem ich nun Erfahrungen sammeln werde.

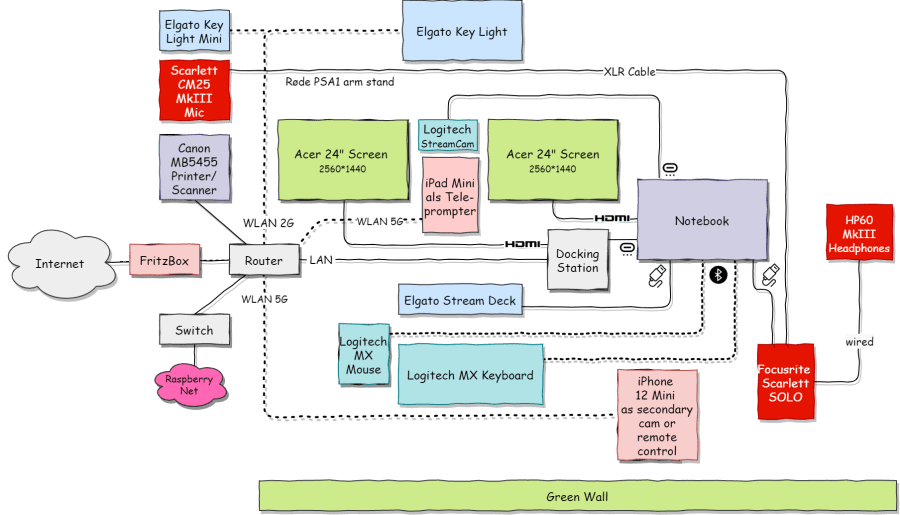

Die Schaltung der Verbindungen ergibt sich aus dem Diagramm. Die Entscheidungen für die Verbindungstechnik ergeben sich aus der verfügbaren Hardware:

Ich nutze zum einen NDI, das ist ein offener Videostreaming-Standard, der WLAN als Träger nutzt. Das klingt für ITler eher normal, in der Videobranche ist das ein Paradigmenwehcsel gewesen, da dort früher Video immer über proprietäre Leitungssysteme übertragen wurde.Für mich heißt das, dass ich mein iPhone oder iPad genauso als Eingangsquelle nutzen kann wie eine Webcam. NDI als Hersteller bietet noch viele weitere Utilities, zum Beispiel auch Screen Capturing.

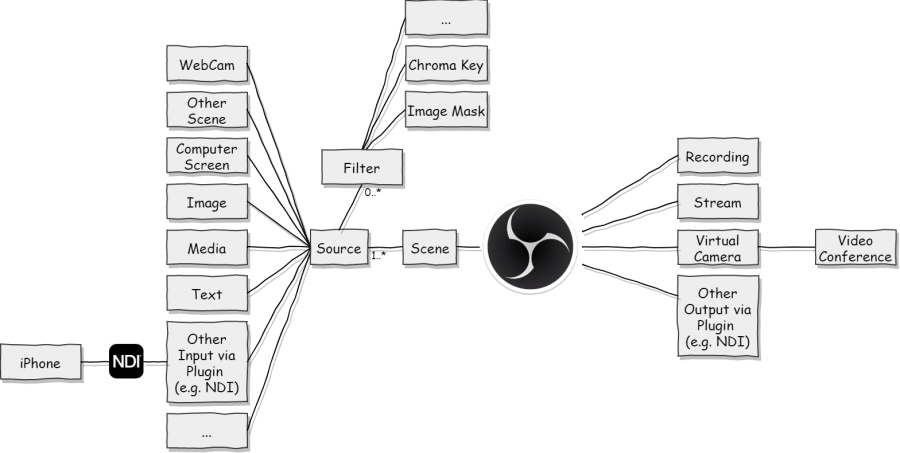

Das wichtigste System ist zweifellos OBS, Open Broadcasting Studio, dass als Video-Effekt- und Mischsystem sehr gut geeignet ist, die verschiedenen Videoquellen zusammenzuführen und neu zu kombinieren. Praktischerweise gibt es ein NDI Plugin, so dass die WLAN-Image-Integration gesichert ist und auch ein Elgato Stream Deck Plugin sorgt für bessere Steuermöglichkeiten. So können bestimmte Konfigurationen auf Knopfdruck abgerufen werden.

Die eigentliche Funktion ergibt sich aus dem Zusammenstellen von verschiedenen Videoquellen zu Szenen. Ganz ähnlich wie bei Photoshop oder ähnlichen Programmen, ist jede Quelle eine Ebene, die individuell durch Positionierung, Skalierung und Filter manipuliert werden kann. Durch einen Filter wird zum Beispiel auch der Green Screen herausgefiltert, so dass dann die gefilmte Person mit anderem Hintergrund weiter genutzt werden kann. Die Ebenen ergeben übereinandergelegt eine Szene, die dann auf verschiedenen Ausgangswegen weitergeleitet wird, so zum Beispiel zur Videokonferenz. Praktischerweise können Szenen auch wieder als Datenquelle genutzt werden, so dass man sich eine kleine Szenenbibliothek anlegt, die dann immer wieder in anderen Zusammenhängen genutzt werden kann.

Das Thema Audio wird natürlich auch hier gemanagt. Dies ist allerdings noch einmal ein Kapitel für sich, so dass ich separat darauf eingehen werde.

Funktional bin ich mit dieser Kombination nun sehr zufrieden, weil sie alle Anforderungen abgeckt, die ich habe. Es gibt noch ein paar Integrations-Hakeleien zu bewältigen, so führt z.B. der vestärkte Einsatz des Stream Decks dazu, dass sich irgendwann die Webcam (oder der OBS-Treiber dafür) aufhängt. Aber das sind Kinderkrankheiten, die sich noch auswachsen werden. Die nächste Show kann beginnen!

Generative KI schleicht sich zunehmend in fast jede Aufgabe ein, an der ich heutzutage arbeite, also ist es an der Zeit, …

Schon vor einer Weile ist mir das Buch -The Math(s) Fix- von Conrad Wolfram über den Weg gelaufen. Ich konnte damals nur …

Ob in der freien Schule oder als Selbstlernende:r,

entwickle deine persönlichen Fähigkeiten weiter, online und global. Ab 8 Jahren.